SLM がエージェントワークフロー拡張の鍵となる理由

ここ数年、AI をめぐる議論は「大きければ大きいほど良い」という考え方に支配されてきました。未処理のスケールこそがインテリジェンスへの唯一の道であるという前提のもと、パラメータ数が数千億、さらには数兆にまで膨れ上がるモデルを私たちは目にしてきました。

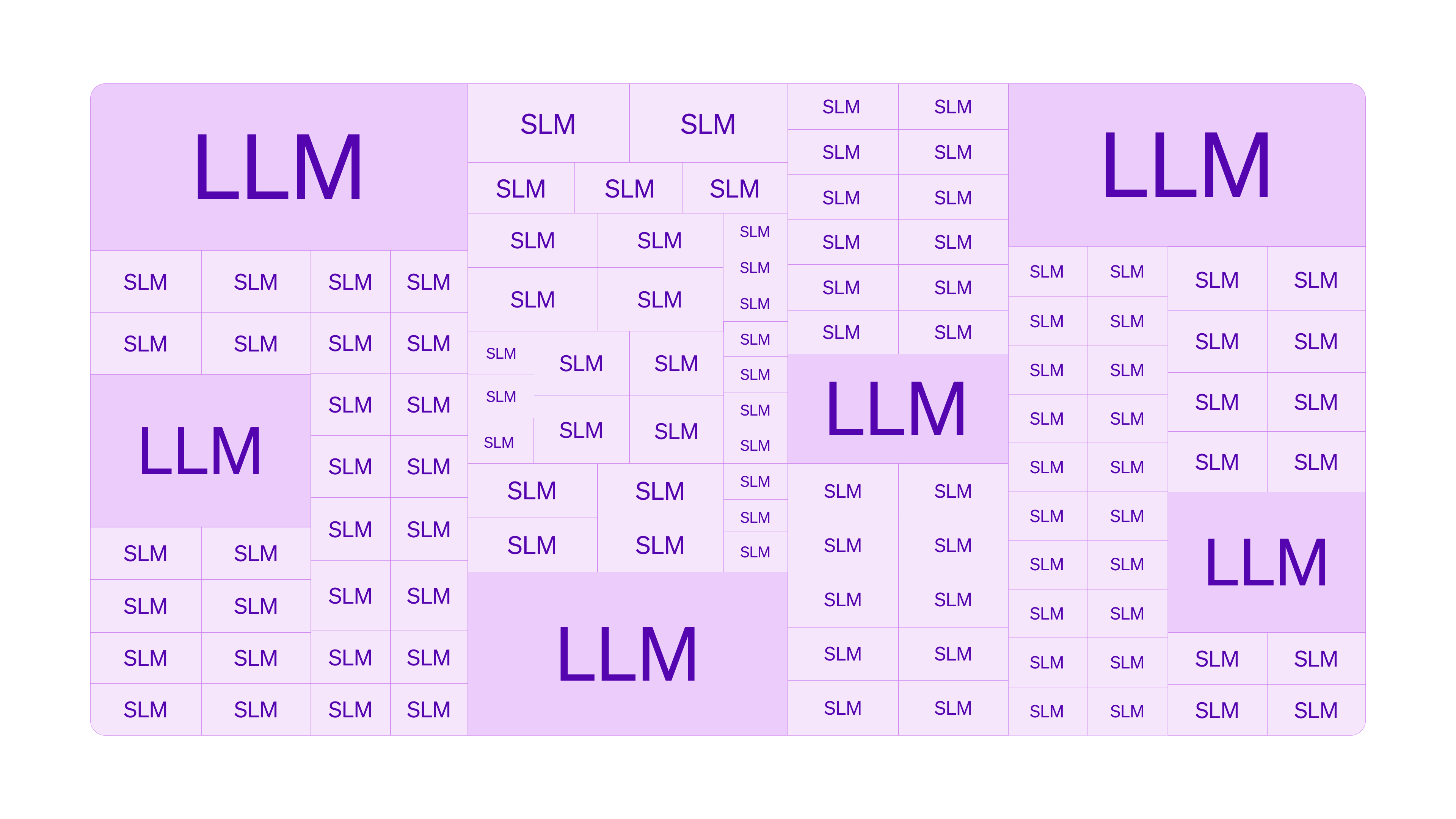

スケーリングは機能性をもたらしますが、同時に導入上のボトルネックにもなります。大規模モデルはあらゆるタスクをこなすには重すぎるため、今まさに変化が起きています。AI の未来、特にエージェントワークフローにおける未来は、「1 つのサイズですべてに対応する」ことではなく、ハイブリッドなアプローチを選択することにあります。

私たちは、すべてのインタラクションに巨大なスーパーコンピュータを使う世界から、Liquid のような小規模言語モデル(SLM)が集まるエコシステムへと移行しています。

LFM のような大規模言語モデル(LLM)が複雑な推論を必要とするタスクを担当する一方で、SLM は実行処理の大部分を担います。

「企業構造」の問題

このシフトがなぜ必要なのかを理解するために、フォーチュン500に名を連ねる物流企業を想像してみてください。倉庫で荷物を仕分けるために、1,000 人の役員を雇うことはないでしょう。

確かに、SVP が箱を梱包することはできます。しかし、彼らはスピード重視で作られているわけではありません。幹部がサプライチェーン全体の「全体像」を考えている間に、倉庫のスペシャリストはすでに 10 個の箱を梱包しています。

AI の文脈で言えば、単純なタスクに大規模モデルを使うことは、不必要なレイテンシーを生みます。タスクは完了しますが、俊敏なスペシャリストには到底及びません。

現在の AI 導入状況は、幹部ばかりの企業のようなものです。

私たちは今、文書から情報を抽出したり、カスタマーチケットをルーティングしたりといった単純なタスクに対しても、推論能力の高い大規模 LLM(「エグゼクティブ」)を使っています。これは非効率で、時間もコストもかかります。

エージェント AI のハイブリッドな未来

- LLM(エグゼクティブ): 高度な推論、複雑な計画、曖昧さへの対応、戦略を担当します。必要なのはごく少数です。

- SLM(スペシャリスト): ドキュメント検索、関数呼び出し、要約など、特化したタスクを処理します。数千単位でデプロイされ、高速かつ低コストです。

柔軟性の要因:SLM が「子ども」のような理由

企業構造の話に加えて、規模を小さくすることには開発面での利点もあります。

大規模な LLM は、終身在職権を持つ大学教授のような存在だと考えてください。世界史や物理学など、幅広い知識を備えています。しかし、基本的な振る舞いを変えようとしたり、まったく新しい高度に専門化された社内用語を教え込もうとすると、途端に硬直してしまいます。彼らを「再教育」するには数か月を要し、コストも非常に高くつきます。

一方、SLM は優秀な子どものような存在です。適応力はありますが、より多くの練習が必要です。新しいスキルを身につけるために反復が必要な学生と同じように、SLM が行動を本当に学習するためには、大規模モデルよりも多くの例を必要とすることがよくあります。しかし、非常に軽量であるため、この反復は安価に行えます。

たとえば、LFM 2.5-1.2B-インストラクト のようなオープンソースの SLM に数千件のサンプルを投入し、その結果を数時間単位で反復的に確認することができます。これにより、特定の社内コンプライアンス文書を、午後のうちにトレーニングすることも可能です。

SLM は、顧客固有のタスクに素早く適応します。ビジネスロジックが変わっても、モデル全体を再構築する必要はありません。スペシャリストに最新情報を与えるだけで済みます。そのため、エージェンシー AI のようなユースケースに最適です。この場合、エージェントは独創的な答えを「幻覚」することなく、厳格かつ変化するプロトコルに従う必要があります。

なぜ採用が遅れているのか?(そして、なぜ今それが変わりつつあるのか)

If specialized models are so effective, why isn't everyone using them yet?

特殊化されたモデルがこれほど効果的であるにもかかわらず、なぜまだ広く使われていないのでしょうか。

現実には、エンタープライズ AI は壁に直面しています。その根本的な理由の一つが、デロイトの 2026 年テックトレンドレポート が指摘する「AI インフラストラクチャの計算」です。

なぜでしょうか。それは、このインフラがそもそも企業規模の AI 向けに設計されていなかったからです。企業は、大規模なクラウドネイティブモデルを現実のワークフローに組み込もうとしていますが、ラボではうまく機能する API ベースのモデルが、本番環境では非常に高コストで、レイテンシーに制約され、運用面でも脆弱であることが明らかになっています。

これは特にエージェントワークフローにおいて顕著です。継続的な推論ループがトークンコストを押し上げ、クラウドの遅延がリアルタイム性を損ないます。Deloitte が指摘しているように、こうした圧力によって組織は、万能なインフラを前提とするのではなく、クラウド、オンプレミス、エッジのどこで推論を実行すべきかを再考せざるを得なくなっています。

これに加えて、AI における「中間管理」レイヤーも、ようやく成熟し始めています。初期のルーティングプロジェクト(RouteLLM など)が道を切り開いてきましたが、本番環境で信頼性を維持するためのエンタープライズグレードのインフラが不足していることが少なくありませんでした。

現在では、ユーザーの問い合わせを確実に評価し、「これは簡単だ。SLM に送ろう」あるいは「これは難しい。LLM を起動しよう」と判断できる、成熟したインテリジェントなオーケストレーションシステムが登場しています。もはや、初期の実験的ツールのような脆さはありません。

Liquid の違い:圧縮ではなく、設計による効率

業界が Liquid Foundational Models(LFM)のような新しいアーキテクチャへと方向転換しているのは、まさにこの点です。これまで業界は、大規模 LLM 向けに設計されたアーキテクチャをそのまま流用し、小さなフットプリントに収まるよう圧縮することでスモールモデルに対応してきました。Liquid AI は、根本的に異なるアプローチを取ります。

巨大な脳を小さくするのではなく、より効率的な脳をゼロから設計します。私たちのモデルは、デフォルトで無駄がなく、高速で、ハードウェアを意識した設計になっています(ハードウェア・イン・ザ・ループによるトレーニング)。トレーニングサイクルが大幅に短縮されることで、Liquid モデルを特定の自社データに合わせて最適化できます。四半期単位ではなく、日単位で。

クラウドにとどまらず、LFM はラップトップ、スマートフォン、ロボット、IoT デバイスなどのエッジに直接導入することも可能です。これにより、低レイテンシーなアクションを実現する超高速オンデバイス SLM と、複雑な推論を担う大規模クラウドモデルとの間をルーターが調整する、強力な新しいエージェントワークフローが実現します。

アクション中のハイブリッドエージェント:リキッド・ファウンデーション・モデル

これが実際のシナリオでどのように機能するのかを想像してみましょう。

電子バンキングアプリに統合された、次世代の金融アシスタントを思い浮かべてください。スマートフォン上で動作する音声アシスタントです。

「今月、食料品にいくら使いましたか?」といった非常にシンプルな質問から、

「50,000 ドルの貯金がありますが、住宅の頭金に使うべきでしょうか?それとも賃貸を続けて投資すべきでしょうか?」といった、より複雑でニュアンスを伴う質問まで、あらゆる財務関連の問いを投げかけることができます。

考え得るすべてのツールを備えた、単一のフロンティア言語モデルに基づくモノリシックなソリューションは、一見すると魅力的に見えます。

.png)

しかし、スケールするにつれて悪化する、現実的な問題が 3 つあります。

コストの肥大化

ツールのリストが長くなるほど、リクエストあたりのトークンコストは増加します。レスポンスのデコードを開始する前に、すでにコンテキストウィンドウの半分が埋まってしまいます。これは出力品質にも悪影響を及ぼします。

レイテンシーの増加

処理すべきツールの説明が多いほど、初期応答は遅くなります。チームが難しい質問をより適切に処理するためにツールを追加するほど、簡単なクエリの 80% に対する待ち時間が悪化します。

対象範囲の拡大による信頼性低下

ツールが増えるほど柔軟性は高まりますが、同時に故障モードも増えます。繰り返しになりますが、「難しい」質問への対応を改善しようとする中で、より簡単なクエリのパフォーマンスが犠牲になる可能性があります。

言い換えれば、モノリスは監査が難しく、壊さずに反復改善することが困難で、コスト構造も非常に高くつきます。

では、代替案は何でしょうか?

成功している ML / AI プロジェクトと同様に、すべては手元のデータを分析することから始まります。

2〜4 週間分の実際のユーザークエリを記録し、その中から、明確なカテゴリに分類できる「簡単なクエリ」80% を特定します。

- クレジットカードの支出/取引

- 口座残高/履歴の確認

- 普通預金口座に関する問い合わせ

- 請求書の支払い

- 最近の取引

- など

ここから、次の要素で構成されるモジュラーシステムを反復的に構築していきます。

- 受信した質問をカテゴリに割り当てる軽量なオーケストレーター。微調整された SLM が驚くほど効果を発揮します。

- 多数の専門 SLM。それぞれが特定カテゴリの問い合わせに対し、必要最小限のツールのみを使って応答します。これにより、トークンコストを線形に増加させることなく、高速かつ高品質な回答が得られます。

- SLM では処理できない最も複雑なクエリを扱う、フォールバック用のフロンティア LM。

.png)

モジュラー構成により、他のメンバーのレイテンシーやパフォーマンスに影響を与えることなく、異なるチームがスペシャリストを改善・追加できます。

.png)

その結果、モノリスよりも正確で、安価で、高速なソリューションが完成します。

ビンゴ。

未来はハイブリッドで、専門化へ

このハイブリッドな未来を実現するためのツールは、すでに整っています。クラウド品質のインテリジェンスを、はるかに低いコストとエネルギーで提供できるタスク特化型モデル ― Liquid の LFM を使って構築しましょう。

今すぐ構築を始めましょう:

- 探索:LFM モデルファミリーを発見する

- 体験:Liquid Playground でレイテンシーを実際に試してみる

- 構築:Docs を確認し、数時間でファインチューニングする方法を学ぶ

- スケール:Liquid AI に お問い合わせ して、ワークフローを変革する

.svg)