ローカルAIエージェントを構築するというアイデアは魅力的ですが、実際に一日中使おうとすると難しさが見えてきます。問題は、モデルにユーザーの意図を理解させることではありません。本当に難しいのは、適切なツールを選び、それをインタラクティブに感じられるほど高速に実行することです。さらに規制の厳しい業界では条件が一段と厳しくなり、エージェントはその処理のためにデータをどこかへ送信することも許されません。ここで LFM2-24B-A2B が真価を発揮します。このモデルは、ローカルのコンシューマー向けハードウェア上でのツールディスパッチのために設計されており、レイテンシ、メモリ、プライバシーといった要素は単なる理論上の制約ではなく、エージェントが製品になるかデモに終わるかを左右する決定的な要素です。

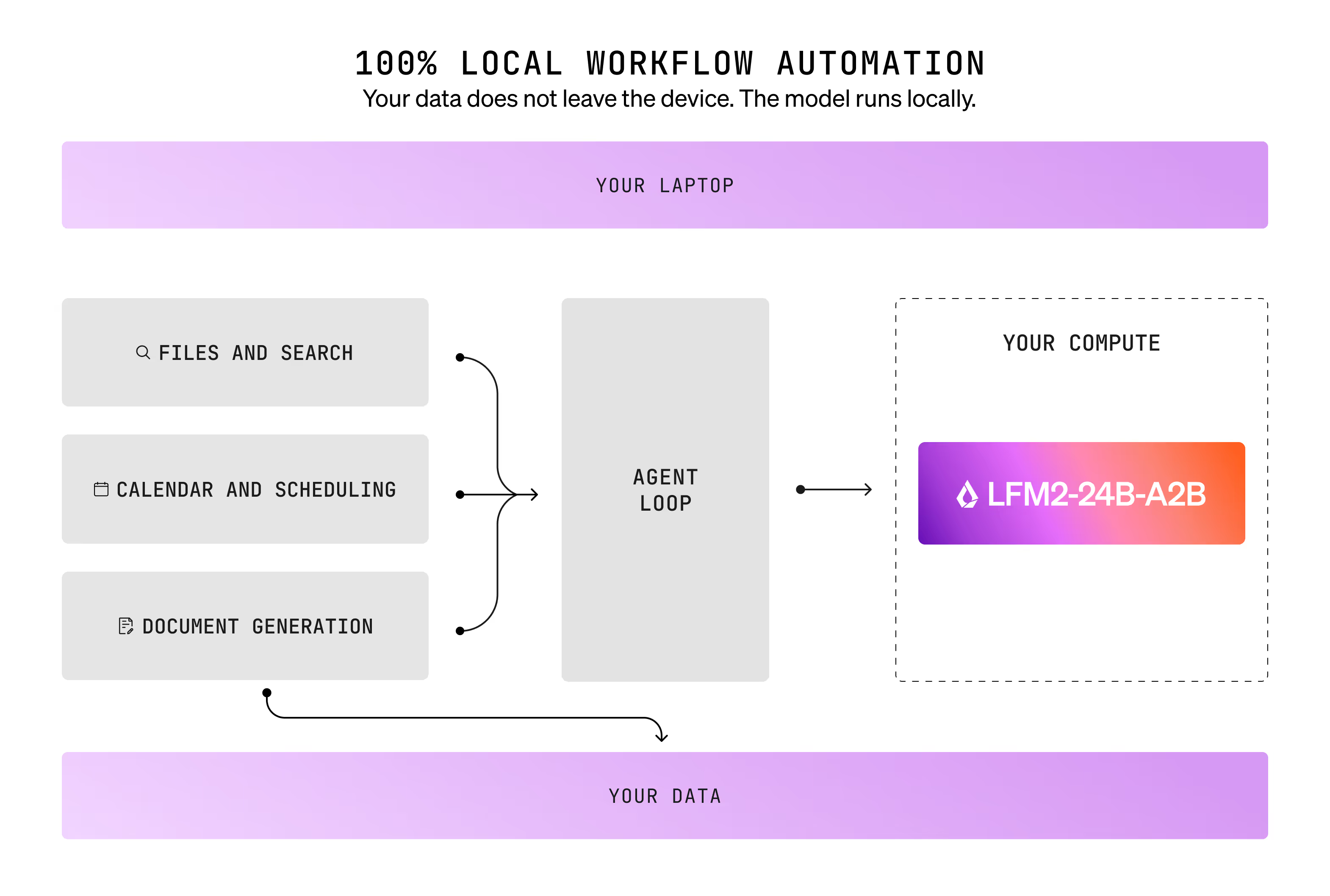

私たちはこの検証のために、LocalCowork というオープンソースのデスクトップエージェントを構築しました。これは完全にデバイス上で動作します。モデル、ツール、そしてすべてのデータがあなたのノートPC内に留まり、クラウドも API キーも不要で、何もマシンの外には送信されません。このアプリのソースコードは Cookbook で公開しています。

以下が私たちの結果です。

ユースケース:ファイルに対してアクションを実行するオンデバイスエージェント

ノートPC上のエージェントの役割はシンプルです。ユーザーの意図を受け取り、それを実際のアクションに変換することです。これは次のような実際のツール群から適切なものを選択することを意味します。

- セキュリティスキャン — フォルダ内に埋もれた API キーや個人情報の漏洩を検出

- 監査ログ — すべてのツール呼び出しを記録し、コンプライアンスレポートを生成

- ドキュメント処理 — テキスト抽出、契約書の差分比較、PDF生成

- ファイル操作 — ファイルシステム全体の一覧表示、読み取り、検索

- システム & クリップボード — システム情報取得、クリップボード読み書き、ディスク使用量確認

実際には、ツールのメニューは大規模で混雑しているため、これを正しく扱うのは見た目以上に難しい問題です。私たちはこの現実的な環境で LFM2-24B-A2B を評価しました。対象は 13 の MCP サーバーにまたがる 67 個のツールで、上記のすべてのカテゴリを含みます。

セットアップ:ローカル、現実的、そしてスケール

すべての処理は 1 台のノートPCで実行されました。

- Apple M4 Max

- 36GB ユニファイドメモリ

- 32 GPU コア

ワークロード

- 単一ステップのツール選択プロンプト:100件

- 複数ステップチェーン:50件(3〜6ステップ)

サービング

- llama-server

- Q4_K_M GGUF

- flash attention 有効

推論設定

- temperature: 0.1

- top_p: 0.1

- max_tokens: 512

目的は、単純なテスト環境でモデルがどれだけ良く見えるかを示すことではありません。実際に購入して持ち運べるマシン上で、ツールを使うユーザー体験を本当に駆動できるのかを測定することでした。

デモ:完全にノートPC上で動作する3つのワークフロー

このデモでは、インターネット接続なしで動作する3つのワークフローを紹介しています。

即時セキュリティスキャンと透明な監査ログ

開発者は LocalCowork に対して、フォルダ内に漏洩したシークレットがないかスキャンするよう指示できます。モデルは即座にセキュリティスキャナーを呼び出し、AWS や Stripe の API キーなどの認証情報を特定し、すべてのアクションをログに記録します。

その後「監査ログを見せて」とリクエストすると、モデルは別のサーバーを呼び出し、何がいつ検出されたかを含むスキャンの完全なログを即座に取得して表示します。

これは、2つの異なる Model Context Protocol(MCP)サーバー間で、サブ秒レベルのツールチェーンが成功することを示しています。

システム情報取得と完全なツール呼び出しの透明性

ユーザーが「自分のシステムについて教えて」とクリックすると、モデルは即座に system info ツールへリクエストを送信します。

デモではツール呼び出しのトレースを展開でき、以下の情報をすべて確認できます。

呼び出されたツール

渡されたパラメータ

実行結果

これにより、ブラックボックスではない透明性の高い動作が実現されていることが示されています。

クロスサーバーのクリップボードアクセス

別のサーバーで新しいセッションを開始した場合でも、モデルはリクエストに応じてサブ秒でクリップボードの内容を取得します。

このデモのポイントはクリップボード機能そのものではありません。ローカルで実行されながら、21個のツールと6つのサーバーの間でリクエストを正確かつ高速にルーティングできるモデルの能力を示しています。

実際の体感:サブ秒のツール選択

このノートPC構成では、LFM2-24B-A2B は ツール選択レスポンスあたり平均約385ms を記録し、このセットアップでは 約14.5GBのメモリに収まりました。

つまり推論中に:

- データがデバイス外に出ることはなく

- 外部 API 呼び出しもなく

- ベンダーのサブプロセッサも存在せず

- 監査対象となる外部送信イベントも発生しません

100件のプロンプトに対する単一ステップのツール選択では 80%の精度を達成しました。

これにより、次のようなシンプルで高効率なインタラクションパターンが可能になります。

- ユーザーが質問する

- エージェントが即座にツール呼び出しを提案する

- ユーザーが確認(または修正)する

- ツールが実行される

- これを繰り返す

このループが高速であれば、精度が完全でなくても実用性は非常に高くなります。なぜなら、修正コストが極めて低いからです。

実際のワークフロー:レシート → 構造化データ → レポート

ベンチマークスイートからの代表的な実世界の処理チェーンの例です。

- レシートフォルダ内の画像を検索

- 最初のレシートをOCRで読み取る

- ベンダー/日付/商品/合計金額を解析

- 重複がないか確認

- 照合済みデータをCSVにエクスポート

- 異常をフラグ付け

- PDFの照合レポートを生成

これは、ツールを使用するエージェントが実環境で失敗しやすいタイプのワークフローです。理由は、個々のステップが特殊だからではなく、エージェントが多くのツールの中から正しいアクションを繰り返し選択しながら、ステップ間で状態を維持する必要があるためです。LFM2の強みは、各ステップを即座に実行されているように感じさせる点にあります。

LFM2が最も強い領域:構造化ドメイン

単一ステップのパフォーマンスは、意図が明確でツールスキーマが明確に定義されているカテゴリで最も高い結果となりました。

私たちが学んだこと

最大のエラーは予測可能なものであり、標準的なポストトレーニングで対処可能です。

サーバー内の類似ツールの混同。誤ったツール選択の多くは、近い機能を持つツール間での混同によるものでした(例:削除が必要な場面で一覧表示ツールを選択するなど)。

「ツール呼び出しなし」のケース。失敗の一部は、モデルがツール呼び出しを出力する代わりに会話形式で応答してしまうことによって発生しました。

マルチステップの自律性は、単一ステップのディスパッチより難しい。LFM2は、このスイートにおいてマルチステップチェーンをエンドツーエンドで完了できたのは26%でした。実用的な示唆として、LFM2は長いチェーンを完全自動で処理するオートパイロットというよりも、ガイド付きループ内で高速にツールを選択するディスパッチャとして最適です。ただし、これらもターゲットを絞ったポストトレーニングによって大幅に改善できます。

LFM2-24B-A2Bはこれまでに17兆トークンで学習されており、現在も事前学習は継続中です。事前学習が完了すると、追加のポストトレーニングと強化学習を含むLFM2.5-24B-A2Bが登場する予定です。

まとめ

このデモは概念実証ではありません。実際のファイルをスキャンし、実際のツールを連携させ、完全な監査ログを備えた動作するデスクトップアプリであり、すべて一般的なコンシューマーハードウェア上で動作しています。モデルは14.5GBに収まり、400ミリ秒未満でツールをディスパッチし、プライバシーに配慮が必要な作業で特に重要となる構造化ドメインを処理できます。

もしコンシューマーマシン向けにローカルエージェントを構築しているなら、LFM2-24B-A2Bは高速でメモリ効率の高い基盤を提供します。ツールスキーマに対して標準的なファインチューニングを行うことで、ユーザーのラップトップ上で直接エージェントタスクを実行する、信頼性が高く応答性の良いソリューションになります。

LocalCoworkはオープンソースで、Cookbookで利用できます。

ぜひ試して、プライベートで低レイテンシなAIの力を体験してください。

.svg)